Qu'est-ce qu'un événement ?

Les attaques islamistes de ce début janvier 2015 à Paris constituent à l’évidence un événement. Tant au sens historique que politique et métapolitique – c’est-à-dire total, culturel, civilisationnel. Il provoque une césure, un basculement vers un monde nouveau, pour partie inconnu : il y aura un « avant » et un « après » les 7-9 janvier 2015. Au-delà des faits eux-mêmes, de leur « écume », ce sont leurs conséquences, leur « effet de souffle », qui importent. Pour la France et avec elle l’Europe, les semaines et mois à venir seront décisifs : ce sera la Soumission ou le Sursaut.

Dans la masse grouillante des « informations » actuelles et surtout à venir, la sidération politico-médiatique et les manipulations de toute sorte, être capable de déceler les « faits porteurs d’avenir » va devenir crucial. Une approche par l’Histoire s’impose. La critique historique, la philosophie de l’histoire et la philosophie tout court permettent en effet chacune à leur niveau de mieux reconnaître ou qualifier un événement. « Pour ce que, brusquement, il éclaire » (George Duby).

C’est donc en essayant de croiser ces différents apports qu’il devient possible de mesurer et « pré-voir » les moments potentiels de bifurcation, l’avènement de l’imprévu qui toujours bouscule l’ordre – ou en l’espèce le désordre – établi. Et c’est dans notre plus longue mémoire, les plis les plus enfouis de notre civilisation – de notre « manière d’être au monde » – que se trouvent plus que jamais les sources et ressorts de notre capacité à discerner et affronter le Retour du Tragique.

Tout commence avec les Grecs…

Ce sont les Grecs qui, les premiers, vont « penser l’histoire » – y compris la plus immédiate.

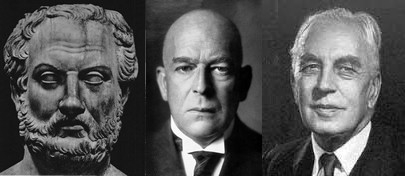

Thucydide ouvre ainsi son Histoire de la guerre du Péloponnèse : « Thucydide d’Athènes a raconté comment se déroula la guerre entre les Péloponnésiens et les Athéniens. Il s’était mis au travail dès les premiers symptômes de cette guerre, car il avait prévu qu’elle prendrait de grandes proportions et une portée dépassant celle des précédentes. (…) Ce fut bien la plus grande crise qui émut la Grèce et une fraction du monde barbare : elle gagna pour ainsi dire la majeure partie de l’humanité. » (1)

Tout est dit.

Et il n’est pas anodin que, engagé dans le premier conflit mondial, Albert Thibaudet ait fait « campagne avec Thucydide » (2)…

Le Centre d’Etude en Rhétorique, Philosophie et Histoire des Idées analyse comme suit ce court mais très éclairant extrait :

1) Thucydide s’est mis à l’œuvre dès le début de la guerre : c’est la guerre qui fait événement, mais la guerre serait tombée dans l’oubli sans la chronique de Thucydide. La notion d’événement est donc duale : s’il provient de l’action (accident de l’histoire), il doit être rapporté, faire mémoire, pour devenir proprement « historique » (c’est-à-dire mémorable pour les hommes). C’est-à-dire qu’un événement peut-être méconnu, mais en aucun cas inconnu.

2) Il n’y a pas d’événement en général, ni d’événement tout seul : il n’y a d’événement que par le croisement entre un fait et un observateur qui lui prête une signification ou qui répond à l’appel de l’événement. Ainsi, il y avait déjà eu des guerres entre Sparte et Athènes. Mais celle-ci se détache des autres guerres – de même que la guerre se détache du cours ordinaire des choses.

3) Etant mémorable, l’événement fait date. Il inaugure une série temporelle, il ouvre une époque, il se fait destin. Irréversible, « l’événement porte à son point culminant le caractère transitoire du temporel ». L’événement, s’il est fugace, n’est pas transitoire : c’est comme une rupture qui ouvre un nouvel âge, qui inaugure une nouvelle durée.

4) L’événement ouvre une époque en ébranlant le passé – d’où son caractère de catastrophe, de crise qu’il faudra commenter (et accessoirement surmonter). Ce qu’est un événement, ce dont l’histoire conserve l’écho et reflète les occurrences, ce sont donc des crises, des ruptures de continuité, des remises en cause du sens au moment où il se produit. L’événement est, fondamentalement, altérité.

5) Thucydide, enfin, qui est à la fois l’acteur, le témoin et le chroniqueur de la guerre entre Sparte et Athènes, se sent convoqué par l’importance de l’événement lui-même. Celui-ci ne concerne absolument pas les seuls Athéniens ou Spartiates, ni même le peuple grec, mais se propage progressivement aux Barbares et de là pour ainsi dire à presque tout le genre humain : l’événement est singulier mais a une vocation universalisante. Ses effets dépassent de beaucoup le cadre initial de sa production – de son « avènement ».

Repérer l’événement nécessite donc d’évacuer immédiatement l’anecdote (le quelconque remarqué) comme l’actualité (le quelconque hic et nunc). Le « fait divers » n’est pas un événement. Un discours de François Hollande non plus…

Il s’agit plus fondamentalement de se demander « ce que l’on appelle événement » au sens propre, c’est-à-dire à quelles conditions se produit un changement remarquable, dont la singularité atteste qu’il est irréductible à la série causale – ou au contexte – des événements précédents.

Histoire des différentes approches historiques de « l’événement »

La recherche historique a contribué à défricher utilement les contours de cette problématique.

L’histoire « positiviste », exclusive jusqu’à la fin du XIXe siècle, a fait de l’événement un jalon, au moins symbolique, dans le récit du passé. Pendant longtemps, les naissances, les mariages et les morts illustres, mais aussi les règnes, les batailles, les journées mémorables et autres « jours qui ont ébranlé le monde » ont dominé la mémoire historique. Chronos s’imposait naturellement en majesté.

Cette histoire « événementielle », qui a fait un retour en force académique à partir des années 1980 (3), conserve des vertus indéniables. Par sa recherche du fait historique concret, « objectif » parce qu’avéré, elle rejette toute généralisation, toute explication théorique et donc tout jugement de valeur. A l’image de la vie humaine (naissance, mariage, mort…), elle est un récit : celui du temps qui s’écoule, dont l’issue est certes connue, mais qui laisse place à l’imprévu. L’événement n’est pas seulement une « butte témoin » de la profondeur historique : il est un révélateur et un catalyseur des forces qui font l’histoire.

Mais, reflet sans doute de notre volonté normative, cartésienne et quelque peu « ethno-centrée », elle a tendu à scander les périodes historiques autour de ruptures nettes, et donc artificielles : le transfert de l’Empire de Rome à Constantinople marquant la fin de l’Antiquité et les débuts du Moyen Age, l’expédition américaine de Christophe Colomb inaugurant l’époque moderne, la Révolution de 1789 ouvrant l’époque dite « contemporaine »… C’est l’âge d’or des « 40 rois qui ont fait la France » et de l’espèce de continuum historique qui aurait relié Vercingétorix à Gambetta.

Cette vision purement narrative est sévèrement remise en cause au sortir du XIXe siècle par une série d’historiens, parmi lesquels Paul Lacombe (De l’histoire considérée comme une science, Paris, 1894), François Simiand (« Méthode historique et science sociale », Revue de Synthèse historique, 1903) et Henri Berr (L’Histoire traditionnelle et la Synthèse historique, Paris, 1921).

Ces nouveaux historiens contribuent à trois avancées majeures dans notre approche de l’événement (4) :

1) Pour eux, le fait n’est pas un atome irréductible de réalité, mais un « objet construit » dont il importe de connaître les règles de production. Ils ouvrent ainsi la voie à la critique des sources qui va permettre une révision permanente de notre rapport au passé, et partant de là aux faits eux-mêmes.

2) Autre avancée : l’unique, l’individuel, l’exceptionnel ne détient pas en soi un privilège de réalité. Au contraire, seul le fait qui se répète, qui peut être mis en série et comparé peut faire l’objet d’une analyse scientifique. Même si ce n’est pas le but de cette première « histoire sérielle », c’est la porte ouverte à une vision « cyclique » de l’histoire dont vont notamment s’emparer Spengler et Toynbee.

3) Enfin, ces historiens dénoncent l’emprise de la chronologie dans la mesure où elle conduit à juxtaposer sans les expliquer, sans les hiérarchiser vraiment, les éléments d’un récit déroulé de façon linéaire, causale, « biblique » – bref, sans épaisseur ni rythme propre. D’où le rejet de l’histoire événementielle, c’est-à-dire fondamentalement de l’histoire politique (Simiand dénonçant dès son article de 1903 « l’idole politique » aux côtés des idoles individuelle et chronologique), qui ouvre la voie à une « nouvelle histoire » incarnée par l’Ecole des Annales.

Les Annales, donc, du nom de la célèbre revue fondée en 1929 par Lucien Febvre et Marc Bloch, vont contribuer à renouveler en profondeur notre vision de l’histoire, notre rapport au temps, et donc à l’événement.

Fondée sur le rejet parfois agressif de l’histoire politique, et promouvant une approche de nature interdisciplinaire, cette école va mettre en valeur les autres événements qui sont autant de clés de compréhension du passé. Elle s’attache autant à l’événementiel social, l’événementiel économique et l’événementiel culturel. C’est une histoire à la fois « totale », parce que la totalité des faits constitutifs d’une civilisation doivent être abordés, et anthropologique. Elle stipule que « le pouvoir n’est jamais tout à fait là où il s’annonce » (c’est-à-dire exclusivement dans la sphère politique) et s’intéresse aux groupes et rapports sociaux, aux structures économiques, aux gestes et aux mentalités. L’analyse de l’événement (sa structure, ses mécanismes, ce qu’il intègre de signification sociale et symbolique) n’aurait donc d’intérêt qu’en permettant d’approcher le fonctionnement d’une société au travers des représentations partielles et déformées qu’elle produit d’elle-même.

Par croisement de l’histoire avec les autres sciences sociales (la sociologie, l’ethnographie, l’anthropologie en particulier), qui privilégient généralement le quotidien et la répétition rituelle plutôt que les fêlures ou les ruptures, l’événement se définit ainsi, aussi, par les séries au sein desquelles il s’inscrit. Le constat de l’irruption spectaculaire de l’événement ne suffit pas: il faut en construire le sens, lui apporter une « valeur ajoutée » d’intelligibilité (5).

L’influence marxiste est évidemment dominante dans cette mouvance, surtout à partir de 1946 : c’est la seconde génération des Annales, avec Fernand Braudel comme figure de proue, auteur en 1967 du très révélateur Vie matérielle et capitalisme.

Déjà, la thèse de Braudel publiée en 1949 (La Méditerranée et le monde méditerranéen à l’époque de Philippe II) introduisait la notion des « trois temps de l’histoire », à savoir :

1) Un temps quasi structural, c’est-à-dire presque « hors du temps », qui est celui où s’organisent les rapports de l’homme et du milieu ;

2) Un temps animé de longs mouvements rythmés, qui est celui des économies et des sociétés ;

3) Le temps de l’événement enfin, ce temps court qui ne constituerait qu’« une agitation de surface » dans la mesure où il ne fait sens que par rapport à la dialectique des temps profonds.

Dans son article fondateur sur la « longue durée », publié en 1958, Braudel explique le double avantage de raisonner à l’aune du temps long :

- l’avantage du point de vue, de l’analyse (il permet une meilleure observation des phénomènes massifs, donc significatifs) ;

- l’avantage de la méthode (il permet le nécessaire dialogue – la « fertilisation croisée » – entre les différentes sciences humaines).

Malgré ses avancées fécondes, ce qui deviendra la « nouvelle histoire » (l’histoire des mentalités et donc des représentations collectives, avec une troisième génération animée par Jacques Le Goff et Pierre Nora en particulier) a finalement achoppé :

- par sa rigidité idéologique (la construction de modèles, l’identification de continuités prévalant sur l’analyse du changement – y compris social) ;

- et sur la pensée du contemporain, de l’histoire contemporaine (par rejet initial, dogmatique, de l’histoire politique).

Pierre Nora est pourtant obligé de reconnaître, au milieu des années 1970, « le retour de l’événement », qu’il analyse de façon défensive comme suit : « L’histoire contemporaine a vu mourir l’événement ‘naturel’ où l’on pouvait idéalement troquer une information contre un fait de réalité ; nous sommes entrés dans le règne de l’inflation événementielle et il nous faut, tant bien que mal, intégrer cette inflation dans le tissu de nos existences quotidiennes. » (« Faire de l’histoire », 1974).

Nous y sommes.

L’approche morphologique : Spengler et Toynbee

Parallèlement à la « nouvelle histoire », une autre approche a tendu à réhabiliter, au XXe siècle, la valeur « articulatoire » de l’événement – et donc les hommes qui le font. Ce sont les auteurs de ce qu’il est convenu d’appeler les « morphologies historiques » : Toynbee et bien sûr Spengler.

L’idée générale est de déduire les lois historiques de la comparaison de phénomènes d’apparence similaire, même s’ils se sont produits à des époques et dans des sociétés très différentes. Les auteurs des morphologies cherchent ainsi dans l’histoire à repérer de « grandes lois » qui se répètent, dont la connaissance permettrait non seulement de comprendre le passé mais aussi, en quelque sorte, de « prophétiser l’avenir ».

Avec Le déclin de l’Occident, publié en 1922, Oswald Spengler frappe les esprits – et il frappe fort. Influencé par les néokantiens, il propose une modélisation de l’histoire inspirée des sciences naturelles, mais en s’en remettant à l’intuition plutôt qu’à des méthodes proprement scientifiques. Sa méthode : « La contemplation, la comparaison, la certitude intérieure immédiate, la juste appréciation des sentiments » (7). Comme les présupposés idéologiques pourraient induire en erreur, la contemplation doit porter sur des millénaires, pour mettre entre l’observateur et ce qu’il observe une distance – une hauteur de vue – qui garantisse son impartialité.

De loin, on peut ainsi contempler la coexistence et la continuité des cultures dans leur « longue durée », chacune étant un phénomène singulier, et qui ne se répète pas, mais qui montre une évolution par phases, qu’il est possible de comparer avec celles d’autres cultures (comme le naturaliste, avec d’autres méthodes, compare les organes de plantes ou d’animaux distincts).

Ces phases sont connues : toute culture, toute civilisation, naît, croît et se développe avant de tomber en décadence, sur des cycles millénaires. Etant entendu qu’« il n’existe pas d’“homme en soi“, comme le prétendent les bavardages des philosophes, mais rien que des hommes d’un certain temps, en un certain lieu, d’une certaine race, pourvus d’une nature personnelle qui s’impose ou bien succombe dans son combat contre un monde donné, tandis que l’univers, dans sa divine insouciance, subsiste immuable à l’entour. Cette lutte, c’est la vie » (8).

Certes, le terme de « décadence » est discutable, en raison de sa charge émotive : Spengler précisera d’ailleurs ultérieurement qu’il faut l’entendre comme « achèvement » au sens de Goethe (9). Certes, la méthode conduit à des raccourcis hasardeux et des comparaisons parfois malheureuses. Mais la grille d’analyse proposée par Spengler reste tout à fait pertinente. Elle réintroduit le tragique dans l’histoire. Elle rappelle que ce sont les individus, et non les « masses », qui font l’histoire. Elle stimule enfin la nécessité de déceler, « reconnaître » (au sens militaire du terme) les éléments constitutifs de ces ruptures de cycles.

L’historien britannique Arnold Toynbee va prolonger en quelque sorte cette intuition avec sa monumentale Etude de l’histoire (A Study of History) en 12 volumes, publiée entre 1934 et 1961 (10). Toynbee s’attache également à une « histoire comparée » des grandes civilisations et en déduit, notamment, que les cycles de vie des sociétés ne sont pas écrits à l’avance dans la mesure où ils restent déterminés par deux fondamentaux :

1) Le jeu de la volonté de puissance et des multiples obstacles qui lui sont opposés, mettant en présence et développant les forces internes de chaque société ;

2) Le rôle moteur des individus, des petites minorités créatrices qui trouvent les voies que les autres suivent par mimétisme. Les processus historiques sont ainsi affranchis des processus de nature sociale, ou collective, propres à l’analyse marxiste – malgré la théorie des « minorités agissantes » du modèle léniniste.

En dépit de ses limites méthodologiques, et bien que sévèrement remise en cause par la plupart des historiens « professionnels », cette approche morphologique est particulièrement stimulante parce qu’elle intègre à la fois la volonté des hommes et le « temps long » dans une vision cyclique, et non pas linéaire, de l’histoire. Mais elle tend à en conserver et parfois même renforcer le caractère prophétique, « hégélien », mécanique. Surtout, elle semble faire de l’histoire une matière universelle et invariante en soi, dominée par des lois intangibles. Pourtant, Héraclite déjà, philosophe du devenir et du flux, affirmait que « Tout s’écoule ; on ne se baigne jamais dans le même fleuve » (Fragment 91).

Le questionnement philosophique

La philosophie, par son approche conceptuelle, permet justement de prolonger cette première approche, historique, de l’événement.

Il n’est pas question ici d’évoquer l’ensemble des problématiques soulevées par la notion d’événement, qui a bien évidemment interrogé dès l’origine la réflexion philosophique par les prolongements évidents que celui-ci introduit au Temps, à l’Espace, et à l’Etre.

L’approche philosophique exige assez simplement de réfléchir aux conditions de discrimination par lesquelles nous nommons l’événement : à quelles conditions un événement se produit-il ? Et se signale-t-il comme événement pour nous ? D’un point de vue philosophique, déceler l’événement revient donc à interroger fondamentalement l’articulation entre la continuité successive des « ici et maintenant » (les événements quelconques) avec la discontinuité de l’événement remarquable (celui qui fait l’histoire) (11).

Dès lors, quelques grandes caractéristiques s’esquissent pour qualifier l’événement :

1) Il est toujours relatif (ce qui ne veut pas dire qu’il soit intrinsèquement subjectif).

2) Il est toujours double : à la fois « discontinu sur fond de continuité », et « remarquable en tant que banal ».

3) Il se produit pour la pensée comme ce qui lui arrive (ce n’est pas la pensée qui le produit), et de surcroît ce qui lui arrive du dehors (il faudra d’ailleurs déterminer d’où il vient, qui le produit). Ce qui n’empêche pas l’engagement, comme l’a souligné – et illustré –Thucydide.

Le plus important est que l’événement « fait sens » : il se détache des événements quelconques, de la série causale précédente pour produire un point singulier remarquable – c’est-à-dire un devenir.

L’événement projette de façon prospective, mais aussi rétroactive, une possibilité nouvelle pour les hommes. Il n’appartient pas à l’espace temps strictement corporel, mais à cette brèche entre le passé et le futur que Nietzsche nomme « l’intempestif » et qu’il oppose à l’historique (dans sa Seconde Considération intempestive, justement). Concept que Hannah Arendt, dans la préface à La Crise de la culture, appelle « un petit non espace-temps au cœur même du temps » (12).

C’est un « petit non espace-temps », en effet, car l’événement est une crise irréductible aux conditions antécédentes – sans quoi il serait noyé dans la masse des faits. Le temps n’est donc plus causal, il ne se développe pas tout seul selon la finalité interne d’une histoire progressive : il est brisé. Et l’homme (celui qui nomme l’événement) vit dans l’intervalle entre passé et futur, non dans le mouvement qui conduirait, naïvement, vers le progrès.

Pour autant, Arendt conserve la leçon de Marx : ce petit non-espace-temps est bien historiquement situé, il ne provient pas de l’idéalité abstraite. Mais elle corrige l’eschatologie du progrès historique par l’ontologie du devenir initiée par Nietzsche : le devenir, ce petit non espace-temps au cœur même du temps, corrige, bouleverse et modifie l’histoire mais n’en provient pas – « contrairement au monde et à la culture où nous naissons, [il] peut seulement être indiqué, mais ne peut être transmis ou hérité du passé. » (13) Alors que « la roue du temps, en tous sens, tourne éternellement » (Alain de Benoist), l’événement est une faille, un moment où tout semble s’accélérer et se suspendre en même temps. Où tout (re)devient possible. Ou bien, pour reprendre la vision « sphérique » propre à l’Eternel Retour (14) : toutes les combinaisons possibles peuvent revenir un nombre infini de fois, mais les conditions de ce qui est advenu doivent, toujours, ouvrir de nouveaux possibles. Car c’est dans la nature même de l’homme, ainsi que l’a souligné Heidegger : « La possibilité appartient à l’être, au même titre que la réalité et la nécessité. » (15)

Prédire ? Non : pré-voir !

Pour conclure, il convient donc de croiser les apports des recherches historiques et des réflexions philosophiques – et en l’espèce métaphysiques – pour tenter de déceler, dans le bruit, le chaos et l’écume des temps, ce qui fait événement.

On aura compris qu’il n’y a pas de recette miracle. Mais que s’approcher de cette (re)connaissance nécessite de décrypter systématiquement un fait dans ses trois dimensions :

1) Une première dimension, horizontale sans être linéaire, plutôt « sphérique » mais inscrite dans une certaine chronologie : il faut interroger les causes et les remises en causes (les prolongements et les conséquences) possibles, ainsi que le contexte et les acteurs : qui sont-ils et surtout « d’où parlent-ils » ? Pourquoi ?

2) Une deuxième dimension est de nature verticale, d’ordre culturel, social, ou pour mieux dire, civilisationnel : il faut s’attacher à inscrire l’événement dans la hiérarchie des normes et des valeurs, le discriminer pour en déceler la nécessaire altérité, l’« effet rupture », le potentiel révolutionnaire qu’il recèle et révèle à la fois.

3) Une troisième dimension, plus personnelle, à la fois ontologique et axiologique, est enfin nécessaire pour que se croisent les deux dimensions précédentes : c’est l’individu qui vit, et qui pense cette vie, qui est à même de (re)sentir l’événement. C’est son histoire, biologique et culturelle, qui le met en résonance avec son milieu au sens large.

C’est donc fondamentalement dans ses tripes que l’on ressent que « plus rien ne sera comme avant ». L’observateur est un acteur « en dormition ». Dominique Venner a parfaitement illustré cette indispensable tension.

Il convient cependant de rester humbles sur nos capacités réelles.

Et pour ce faire, au risque de l’apparente contradiction, relire Nietzsche. Et plus précisément Par-delà le bien et le mal : « Les plus grands événements et les plus grandes pensées – mais les plus grandes pensées sont les plus grands événements – sont compris le plus tard : les générations qui leur sont contemporaines ne vivent pas ces événements, elles vivent à côté. Il arrive ici quelque chose d’analogue à ce que l’on observe dans le domaine des astres. La lumière des étoiles les plus éloignées parvient en dernier lieu aux hommes ; et avant son arrivée, les hommes nient qu’il y ait là … des étoiles. »

Grégoire Gambier (Institut Iliade, 18 janvier 2015)

Ce texte est une reprise actualisée et légèrement remaniée d’une intervention prononcée à l’occasion des IIe Journées de réinformation de la Fondation Polemia, organisées à Paris le 25 octobre 2008.

Notes

(1) Histoire de la guerre du Péloponnèse de Thucydide, traduction, introduction et notes de Jacqueline De Romilly, précédée de La campagne avec Thucydide d’Albert Thibaudet, Robert Laffont, coll. « Bouquins », Paris, 1990.

(2) Ibid. Dans ce texte pénétrant, Thibaudet rappelle notamment l’histoire des livres sibyllins : en n’achetant que trois des neuf ouvrages proposés par la Sybille et où était contenu l’avenir de Rome, Tarquin condamna les Romains à ne connaître qu’une fraction de vérité – et d’avenir. « […] peut-être, en pensant aux six livres perdus, dut-on songer que cette proportion d’un tiers de notre connaissance possible de l’avenir était à peu près normale et proportionnée à l’intelligence humaine. L’étude de l’histoire peut nous amener à conclure qu’en matière historique il y a des lois et que ce qui a été sera. Elle peut aussi nous conduire à penser que la durée historique comporte autant d’imprévisible que la durée psychologique, et que l’histoire figure un apport incessant d’irréductible et de nouveau. Les deux raisonnements sont également vrais et se mettraient face à face comme les preuves des antinomies kantiennes. Mais à la longue l’impression nous vient que les deux ordres auxquels ils correspondent sont mêlés indiscernablement, que ce qui est raisonnablement prévisible existe, débordé de toutes parts par ce qui l’est point, par ce qui a pour essence de ne point l’être, que l’intelligence humaine, appliquée à la pratique, doit sans cesse faire une moyenne entre les deux tableaux ».

(3) Après bien des tâtonnements malheureux, les manuels scolaires ont fini par réhabiliter l’intérêt pédagogique principal de la chronologie. Au niveau académique, on doit beaucoup notamment à Georges Duby (1919-1996). Médiéviste qui s’est intéressé tour à tour, comme la plupart de ses confrères de l’époque, aux réalités économiques, aux structures sociales et aux systèmes de représentations, il accepte en 1968 de rédiger, dans la collection fondée par Gérald Walter, « Trente journées qui ont fait la France », un ouvrage consacré à l’un de ces jours mémorables, le 27 juillet 1214. Ce sera Le dimanche de Bouvines, publié pour la première fois en 1973. Une bombe intellectuelle qui redécouvre et exploite l’événement sans tourner le dos aux intuitions braudeliennes. Cf. son avant-propos à l’édition en poche (Folio Histoire, 1985) de cet ouvrage (re)fondateur : « C’est parce qu’il fait du bruit, parce qu’il est ‘grossi par les impressions des témoins, par les illusions des historiens’, parce qu’on en parle longtemps, parce que son irruption suscite un torrent de discours, que l’événement sensationnel prend son inestimable valeur. Pour ce que, brusquement, il éclaire. »

(4) Cette analyse, ainsi que celle qui suit concernant l’Ecole des Annales, est directement inspirée de La nouvelle histoire, sous la direction de Jacques Le Goff, Roger Chartier et Jacques Revel, CEPL, coll. « Les encyclopédies du savoir moderne », Paris, 1978, pp. 166-167.

(5) Cf. la revue de sociologie appliquée « Terrain », n°38, mars 2002.

(6) Cf. L’histoire, Editions Grammont, Lausanne, 1975, dont s’inspire également l’analyse proposée des auteurs « morphologistes » – Article « Les morphologies : les exemples de Spengler et Toynbee », pp. 66-73.

(7) Ibid.

(8) Ecrits historiques et philosophiques – Pensées, préface d’Alain de Benoist, Editions Copernic, Paris, 1979, p. 135.

(9) Ibid., article « Pessimisme ? » (1921), p. 30.

(10) Une traduction française et condensée est disponible, publiée par Elsevier Séquoia (Bruxelles, 1978). Dans sa préface, Raymond Aron rappelle que, « lecteur de Thucydide, Toynbee discerne dans le cœur humain, dans l’orgueil de vaincre, dans l’ivresse de la puissance le secret du destin », ajoutant : « Le stratège grec qui ne connaissait, lui non plus, ni loi du devenir ni décret d’en haut, inclinait à une vue pessimiste que Toynbee récuse tout en la confirmant » (p. 7).

(11) L’analyse qui suit est directement inspirée des travaux du Centre d’Etudes en Rhétorique, Philosophie et Histoire des Idées (Cerphi), et plus particulièrement de la leçon d’agrégation de philosophie « Qu’appelle-t-on un événement ? », www.cerphi.net.

(12) Préface justement intitulée « La brèche entre le passé et le futur », Folio essais Gallimard, Paris, 1989 : « L’homme dans la pleine réalité de son être concret vit dans cette brèche du temps entre le passé et le futur. Cette brèche, je présume, n’est pas un phénomène moderne, elle n’est peut-être même pas une donné historique mais va de pair avec l’existence de l’homme sur terre. Il se peut bien qu’elle soit la région de l’esprit ou, plutôt, le chemin frayé par la pensée, ce petit tracé de non-temps que l’activité de la pensée inscrit à l’intérieur de l’espace-temps des mortels et dans lequel le cours des pensées, du souvenir et de l’attente sauve tout ce qu’il touche de la ruine du temps historique et biographique (…) Chaque génération nouvelle et même tout être humain nouveau en tant qu’il s’insère lui-même entre un passé infini et un futur infini, doit le découvrir et le frayer laborieusement à nouveau » (p. 24). Etant entendu que cette vision ne vaut pas négation des vertus fondatrices de l’événement en soi : « Ma conviction est que la pensée elle-même naît d’événements de l’expérience vécue et doit leur demeurer liés comme aux seuls guides propres à l’orienter » – Citée par Anne Amiel, Hannah Arendt – Politique et événement, Puf, Paris, 1996, p. 7.

(13) Ibid. Ce que le poète René Char traduira, au sortir de quatre années dans la Résistance, par l’aphorisme suivant : « Notre héritage n’est précédé d’aucun testament » (Feuillets d’Hypnos, Paris, 1946).

(14) Etant entendu que le concept n’a pas valeur historique, ni même temporelle, car il se situe pour Nietzsche en dehors de l’homme et du temps pour concerner l’Etre lui-même : c’est « la formule suprême de l’affirmation, la plus haute qui se puisse concevoir » (Ecce Homo). L’Eternel retour découle ainsi de la Volonté de puissance pour constituer l’ossature dialectique du Zarathoustra comme « vision » et comme « énigme » pour le Surhomme, dont le destin reste d’être suspendu au-dessus du vide. Pour Heidegger, les notions de Surhomme et d’Eternel retour sont indissociables et forment un cercle qui « constitue l’être de l’étant, c’est-à-dire ce qui dans le devenir est permanent » (« Qui est le Zarathoustra de Nietzsche ? », in Essais et conférences, Tel Gallimard, 1958, p. 139).

(15) « Post-scriptum – Lettre à un jeune étudiant », in Essais et conférences, ibid., p. 219. En conclusion à la conférence sur « La chose », Heidegger rappelle utilement que « ce sont les hommes comme mortels qui tout d’abord obtiennent le monde comme monde en y habitant. Ce qui petitement naît du monde et par lui, cela seul devient un jour une chose »…